當地時間2月21日,谷歌發布號稱“全球性能最強大、輕量級”的新一代開源系列模型Gemma,平均性能遠超Llama 13B,一舉奪下當今的開源大模型霸主的寶座。

由此,在其多模態大模型Gemini與OpenAI在閉源領域激戰正酣之時,谷歌終又以Gemma在開源領域向Meta宣戰。

谷歌和Alphabet公司CEO Sundar Pichai表示:“Gemma展示了強大的性能,從今天開始,該模型將在全球範圍內提供,並可在筆記本電腦、工作站或谷歌雲上運行。”

官方介紹稱,Gemma靈感源于Gemini,由谷歌DeepMind和其他團隊合作開發。

不同于Gemini的“全家桶”路線,Gemma主打“輕量級”“高性能”特點,提供了2B(20億)和7B(70億)兩種參數規格,每個規模又分爲預訓練和指令微調兩個版本,滿足了開發人員的不同需求。

該模型可在筆記本電腦、台式機、物聯網、移動設備、雲端等多個主流設備類型上運行。其中,7B版本用于在消費級GPU和TPU上高效部署和開發;2B版本則可直接在筆記本電腦上運行。

Gemma基于谷歌的開源模型和生態構建,包括Word2Vec、BERT、T5、T5X等。而得益于Gemini的共享技術和基礎架構,Gemma在MMLU、MBPP等18個語言理解、推理、數學等關鍵基准測試中,有11個測試分數超越了Llama 2等更大參數的開源模型。

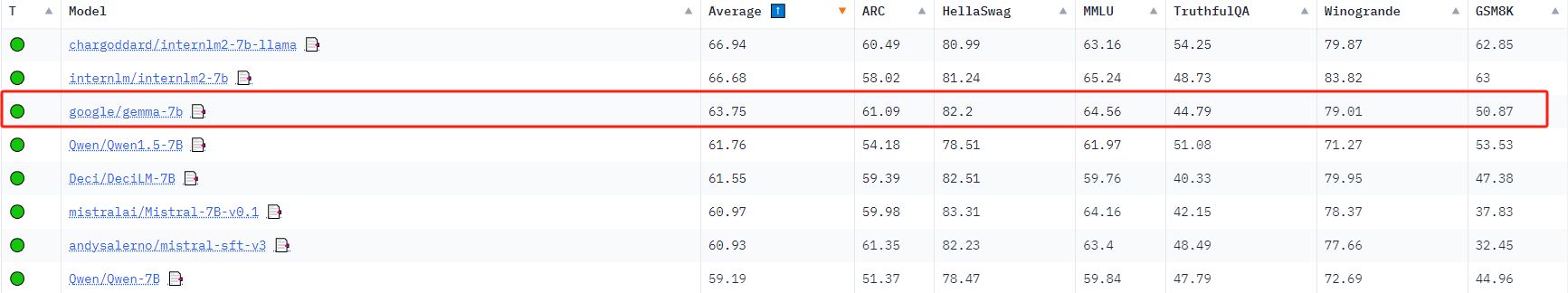

值得一提的是,Gemma在數學、代碼能力上的表現十分突出,位于Hugging Face開源大模型排行榜前列。

據稱,Gemma基于自研AI加速芯片TPU v5e訓練,在文本領域實現了強大的通用能力,同時具備最先進的理解和推理技能。其中,7B使用了4096個TPU v5e,2B則使用了512個TPU v5e,數據主要來自網絡文檔、數學和代碼的英語數據。

不僅如此,谷歌還宣布與英偉達合作,利用英偉達TensorRT-LLM加速Gemma的性能;另還可以使用英偉達GPU來優化Gemma模型;英偉達的RTX聊天系統也即將向Gemma開放入駐,更好地保障了用戶的數據安全。

軟件工具:配套齊全 開發人員友好除模型本身外,谷歌還爲開發者提供了一套名爲Responsible Generative AI Toolkit的AI軟件工具包,在安全分類、調試和指導三個方面,幫助開發人員和研究人員優先構建安全且負責任的AI應用程序:

綜上所述,Gemma似已成功在編碼、數據處理、架構設計、指令優化、基于人類反饋的強化學習以及評估方法等方面,成爲了Gemini的“愛徒”。

谷歌DeepMind産品管理總監Tris Warkentin認爲,雖然Gemma已在6個安全基准及人類並行評估方面均優于競爭對手,但將繼續采取與其潛在風險相當的評估和安全解決措施。

開源的Gemma,無疑將會吸引一衆軟件工程師在谷歌技術的基礎上進行開發,增強雲部門的盈利能力和專業能力。

谷歌Developer X和開發者關系副總裁兼總經理Jeanine Banks表示:“如果谷歌能夠成爲API和開放模型的唯一提供商,爲社區提供最廣泛的功能集,那就完美了。”