功能機時代,人們通過物理按鍵點按的方式與手機進行交互。到了智能手機時代,人機交互的方式變爲了多點觸控。隨著5G技術的普及,智能手機將作爲萬物互聯的起點,與不同設備進行協同工作。

如果將上述這套說辭套用到汽車的車機上,其實也同樣適用。在特斯拉Model S問世之前,傳統汽車的車機可以分爲兩個階段:純物理按鍵和屏幕+按鍵。

在這一階段,人車的交互方式類似于功能機,更多的是點擊物理按鍵。此時此刻,傳統車機還不具備智能化的服務和功能。

特斯拉Model S誕生後,正式開啓了汽車大屏車機時代。也就是那時,人車交互方式從原先的點擊物理按鍵逐步變爲觸屏操作,同時賦予了車載系統一定的智能屬性。

新能源發展初期,絕大多數車企旗下的車型依舊只是配備了傳統車機,爲了幫助這部分車企解決汽車車機不夠智能的問題,各大手機廠商分別推出了不同的手車互聯的軟件,例如蘋果CarPlay、華爲HiCar、小米CarWith等。

後來,隨著手機廠商紛紛入局新能源汽車市場,以及傳統車企發力新能源車型,再加上受特斯拉影響,現在的車機大多以「大號平板」的形態呈現,以往的功能項物理按鍵也被集成在了觸屏操作邏輯的智能車機中。

現在的智能車機,除了可以設置汽車相關功能外,還能夠安裝部分手機或平板的應用,實現了觀影、遊戲等功能。這不禁讓人産生了疑惑,車機智能化的方向是不是智能手機或平板化?現在的智能車機體驗下來,給人的感覺更像是「大號青春版」智能手機或平板。

車機的智能化未來,屬于AI?

事實上,以平板形態呈現的智能車機只是過渡方案。我們可以從手機廠商或造車新勢力的智能車機上,推導出車機智能化的最終形態。

此前,理想宣布旗下所有車型的車機將接入自研的AI大語言模型——Mind GPT,語音助手理想同學將變得更加智能,不僅支持語音AI繪圖,還可以講笑話、科普知識等。

或許你會覺得這是一件很傻的事情,誰會在車機上進行AI繪畫?又有多少人會在車裏用到這些AI相關的功能?我們都知道,智能手機作爲人們日常生活中不可或缺的工具,在AI大語言模型的加持下,可以幫助用戶提高工作效率,或者輔助用戶進行創作。

與之相反,汽車是人們生活中的代步工具,其內置的智能車機更多的是輔助車主完成一些車內的設置或輔助駕駛,只有在停車等人的狀態下,車主才可能會使用智能車機的娛樂功能,比如看電影或者玩些休閑遊戲,以此來打發時間。這樣一想,是不是更覺得理想車機接入GPT有點「畫蛇添足」了?

然而並非如此。AI大語言模型帶來的核心升級點在于機器對人類語義的理解。舉個例子,以往我們在和某平台智能客服咨詢問題時,往往會自動彈出幾條預先設置好的問題選項,當你發現自己想要提問的問題不在那些選項中時,通常會將問題以文字的形式發送給智能客服,結果智能客服無法回答超出預設置好的問題,最後你只能選擇轉接人工客服。

現在,凡是接入GPT的智能客服,無需提前設置好問題,單憑AI對客戶語義的理解,就可以直接以自然的方式解答客戶反饋的問題。

而理想在自家車機中接入自研GPT,其真正的目的可能是強化理想同學的語音識別率,以及與用戶對話的理解能力。像AI繪圖、AI講笑話等只是AI附帶的功能,理想可能想要通過這些功能,讓用戶覺得理想同學變得更聰明了。

講到人車的語音交互,就不得不提一嘴百度與吉利深度合作的智能電車極越01。這款智能電車支持車內外的語音控制功能,需要用戶事先錄入聲音信息,這樣極越01就可以通過聲紋認證來識別車主身份。

極越01內置的語音助手“SIMO”可以精准識別車主發出的長語音指令,不管是車內和車外它都可以做到快速響應。而且SIMO首次喚醒後,車主每次與之交互時無需再喊其名字,直接語音發送指令,SIMO就可以識別這段指令並執行。正因如此,官方將其定義爲汽車新物種,汽車中的機器人。

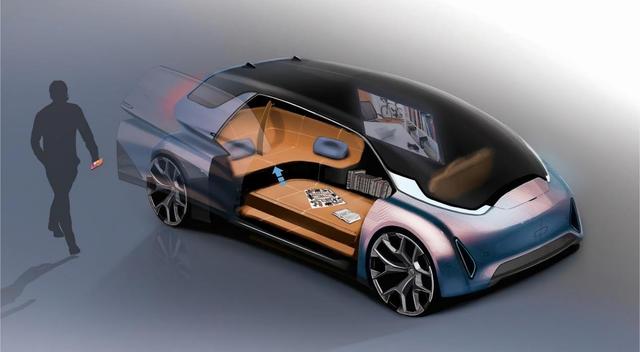

按照這個思路,我們不妨試想一下,當L5級別的輔助駕駛落地後,汽車不再需要方向盤,也不再需要平板形態的車機,用戶想要與汽車進行交互,直接對話車內的AI即可。由AI全程駕駛汽車,用戶通過MR的方式在車內娛樂,這或許才是車機智能化的最終形態。

人車交互方式,不僅限于觸屏和語音

受限于技術,現在的智能車機交互無非就兩種:觸屏和語音。但是,隨著AI技術的越發成熟,人車的交互方式也在不斷擴展和升級。

前不久,索尼在CES上展示了與本田合作的純電轎車——AFEELA。有意思的地方在于AFEELA支持PS5手柄的遠程遙控,這就跟小時候玩的電動遙控汽車玩具一樣,搖杆向前推動,AFEELA也會跟著向前移動,搖杆向後推,AFEELA便會向後倒車。

現階段的智能電車,雖然可以借助高階輔助駕駛的自動泊車、自動召喚功能,讓汽車自己完成停車和迎接車主,但是實際用起來,這些功能的可用度並不是很高。在高階智駕足夠成熟之前,索尼這套手柄遠程控車的方案可行性會更高,前提條件是需要極低的延遲、極好的網絡環境。

除索尼外,榮耀也在積極探索人車交互更多的可能性。此前,榮耀在今年的MWC上展示了一項AI黑科技——眼動控車。從發布會的演示片中可以看出,只要將人眼對准榮耀Magic 6 Pro的前置攝像頭,隨著人眼視線的移動,車子也會隨之移動。

就目前來看,榮耀的眼動控車需要依托于榮耀Magic 6 Pro的眼動控制和前置攝像頭,實時捕捉人眼運動軌迹和焦點,通過AI算法來判斷用戶眼睛停留在哪個選項,然後手機將這一信號傳遞給車機,最後由車機來調用汽車的動力。

不管是索尼還是榮耀,手柄控車還是眼動控車,這些全新的人車交互方式,都處在第一步。它們的實現方式都需要不同的載體作爲向車機傳遞信號的「中轉站」。

未來,人在車外,人車交互方式應該是不需要用戶使用任何工具,也無需與車機的AI語音對話,汽車通過外部的攝像頭和感知元件,自動識別當前所處環境,車機內置的AI根據車主的行爲進行預判,比如當車主在車外開始移動時,車機會自動判斷是否跟隨或者停留。

還有一種人車的交互方式,那就是AR HUD。像華爲問界M9、極氪007等就已經搭載了這項技術。AR HUD是擡頭顯示的一種,主要是將一些信息投屏到汽車前面的擋風玻璃,例如導航路線,可以防止車主在駕駛期間低頭,實現盲操作,進一步提升了駕駛汽車的安全性。

不過,現階段的AR HUD,分辨率、亮度、清晰度都還遠遠不夠,在一些大光比的環境下,車主很難看清AR HUD所顯示的信息。

其實隨著汽車智能化的高度發展,廠商們在人車交互的硬件上也做出了很多思考和探索。好比阿維塔12可供用戶選裝的電子後視鏡。傳統汽車司機想要看清後方車輛時,需要事先手動調整好後視鏡的位置,然後還需要車主將視線短暫移至窗外。

現在,你只需要將視線移至車內左前或者右前方的電子屏幕,就可以實時查看後方車輛的位置。

但是,受限于攝像頭傳感器,電子後視鏡的視野範圍偏窄,即便支持廣角/近景的焦距切換,但每次切換攝像頭都要重新對焦,這也就意味著在切換過程中,電子後視鏡會出現短暫的虛焦,而且到了晚上,由于光線的不足,電子後視鏡所拍攝的畫面也會變得比較模糊。雖然電子後視鏡設計之初的出發點很好,但現階段的實用價值並不高。

未來,汽車或許不再需要後視鏡,單憑車身外部多顆感知元件和攝像頭,以及車身內部的AI車機就可以實現對周邊環境的感知,甚至可以提前預判。當後視鏡消失之時,自然也就不再需要駕駛員了,全程交給AI接管即可。

爲了降低車身的風阻,很多車企推出了隱藏式電動門把手,稍微極端點地直接取消門把手,改用觸控按鈕設計。伸手-拉開-關閉這三步是我們在打開/關閉傳統汽車車門的必要操作。現在我們和車門之間的交互變得更加優雅,按下-踩刹車,車門自動關閉,省去了你再用手關車門這一步驟。

與取消車門門把手的設計相比,隱藏式門把手在現實生活中並沒有那麽好用,尤其是在冬季,隱藏式門把手很容易被凍住,導致車主無法開啓車門。哪怕在非冬季使用,隱藏式門把手也會經常出現無法彈出的問題。

兩種設計一對比會發現,取消門把手的設計會更貼合未來,當AI變得足夠聰明時,觸摸按鍵將被取消,汽車會自動識別車主身份,並判斷是否開啓車門,車主上車後,車門自動關閉,整個過程十分無感和順暢。

我們都知道,科技是要化繁爲簡,爲人們帶來便利。如果按照這個思路,上述所有人車交互,最終會變爲無感知的、完成度極高的的AI交互。當一輛汽車擁有人類思考方式,你可以將自己的生命放心交給它,讓它來駕駛時,這或許才是人車交互的最佳方案。

智能車機≠平板或大號手機

其實,L5級別的智駕已經有相關車型出來了。早在2021年,百度便發布了L5級別智駕的汽車機器人鷗翼門Apollo。這輛車沒有方向盤,也沒有任何加速和刹車的腳踏板。由于現在L5級別的汽車成本較高,再加上相關的政策沒有下來。所以,消費級L5級別的智能汽車可能要等到2040年之後。

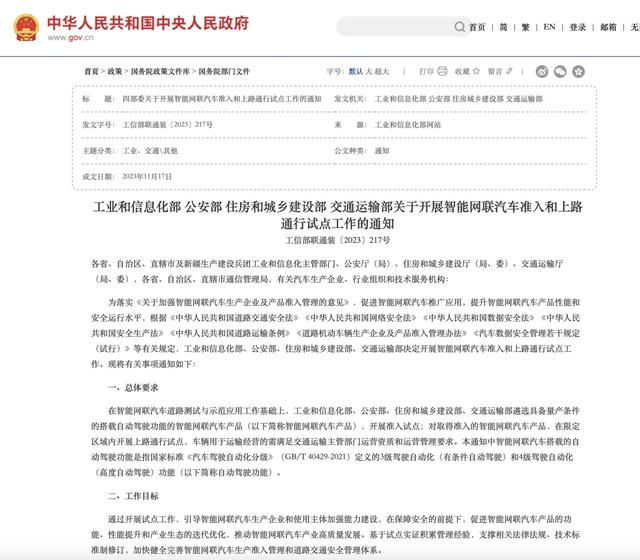

因爲去年11月,工信部、信息部、公安部、住房和城鄉建設部才剛公布關于L3、L4級別的汽車試點相關規定。

不過,目前搭載高階智駕的汽車絕大多數還停在L2的級別,今年可能會出現L3級別的汽車,至于L4級別的汽車可能要等到2027年之後。

所以,現在的智能車機,交互方式與平板或手機類似,因爲受限于相關管理規定,廠商們想到的過渡方案罷了。汽車真正的智能化方向,一定是像百度Apollo那樣的,無方向盤、無腳踏板、無車門把手、無後視鏡,只有L5級別的自動駕駛以及AI。未來的人車交互方式,也只是需要動動嘴皮,其他全部交給AI。